Cette semaine, la revue scientifique Frontiers in Cell and Developmental Biology a publié une recherche présentant de fausses images réalisées avec Midjourney, l'un des générateurs d'images IA les plus populaires.

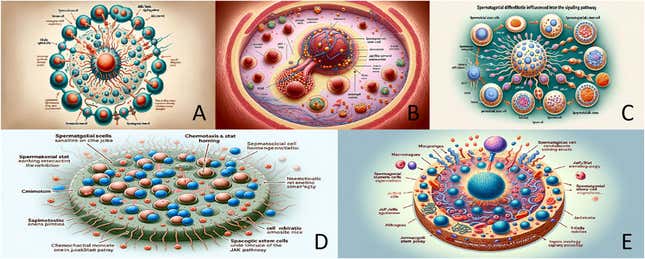

Le libre accès papier explore la relation entre les cellules souches des testicules des mammifères et une voie de signalisation responsable de la médiation de l'inflammation et du cancer dans les cellules. Le contenu écrit de l'article ne semble pas faux, mais ses aspects les plus frappants ne se trouvent pas dans la recherche elle-même. Il s’agit plutôt de représentations inexactes et grotesques de testicules de rat, de voies de signalisation et de cellules souches.

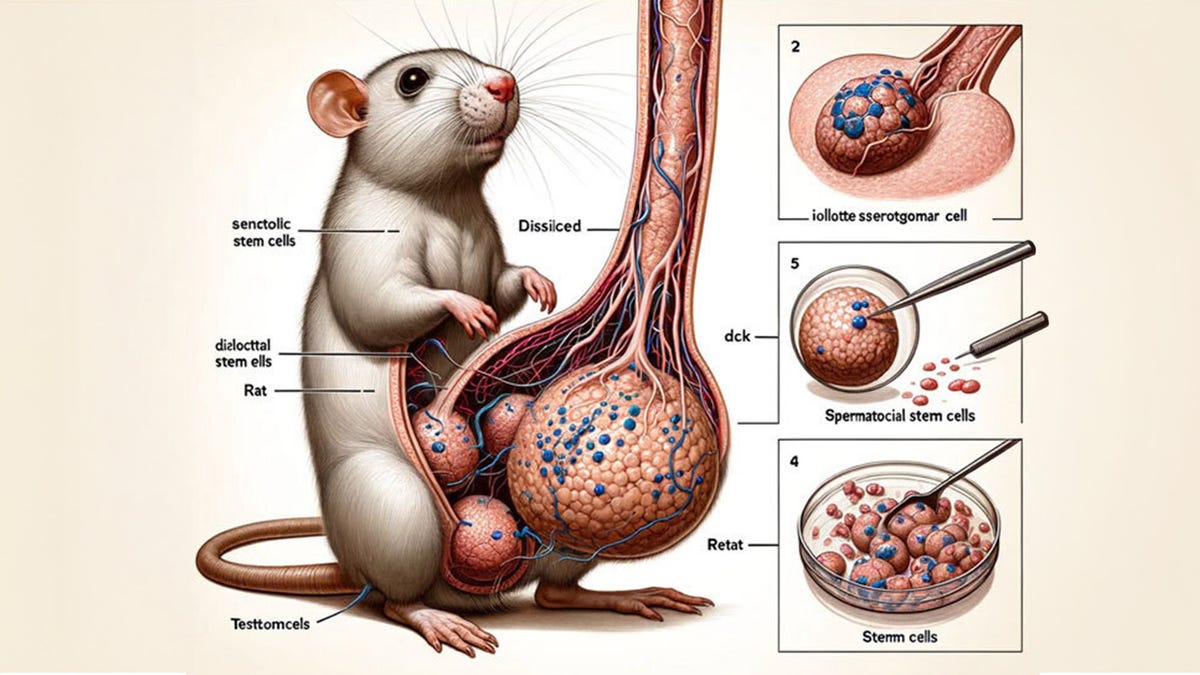

Le diagramme de rat généré par l’IA représente un rat (étiqueté utilement et correctement) dont le haut du corps est étiqueté comme « cellules souches senctoliques ». Ce qui semble être un très gros pénis de rat est étiqueté « Dissilced », avec des encarts à droite pour mettre en évidence la « cellule iollotte sserotgomar », « dck » et « Retat ». Hmm.

Selon Directives de l'éditeur de Frontiers, les manuscrits sont soumis à des « contrôles de qualité initiaux » par l’équipe d’intégrité de la recherche et l’éditeur chargé du traitement avant le processus d’évaluation par les pairs. Autrement dit, de nombreux regards auraient examiné ce travail avant la publication des images.

Au crédit des chercheurs, ils déclarent dans l'article que les images de l'article ont été générées par Midjourney. Mais les frontières site pour les politiques et l'éthique de la publication note que des corrections peuvent être soumises si « il y a une erreur dans un chiffre qui ne modifie pas les conclusions » ou « des chiffres sont mal étiquetés », entre autres facteurs. Les images générées par l’IA semblent certainement relever de ces catégories. Dingjun Hao, chercheur à l'Université Xi'an Jiaotong et co-auteur de l'étude, n'a pas immédiatement répondu à la demande de commentaires de Gizmodo.

L’image du rat est manifestement fausse, même si vous n’avez jamais ouvert les organes génitaux d’un rat. Mais les autres chiffres du journal pourraient paraître crédibles à un œil non averti, du moins à première vue. Pourtant, même quelqu'un qui n'a jamais ouvert un manuel de biologie verrait, après un examen plus approfondi, que les étiquettes sur chaque diagramme ne sont pas tout à fait anglaises – un signe révélateur d'un texte généré par l'IA en imagerie.

L'article a été édité par un expert en reproduction animale de l'Institut national de recherche laitière en Inde et révisé par des chercheurs de Northwestern Medicine et de l'Institut national de nutrition et de physiologie animales. Alors comment ces images farfelues ont-elles été publiées ? Frontiers in Cell and Developmental Biology n'a pas immédiatement répondu à une demande de commentaires.

Le générateur de texte OpenAI ChatGPT est suffisamment compétent pour obtenir la recherche farkakte au-delà des yeux soi-disant perspicaces des évaluateurs. Une étude menée par des chercheurs de l'Université Northwestern et de l'Université de Chicago a révélé que les experts humains étaient trompés par les résumés scientifiques produits par ChatGPT dans 32 % des cas.

Ainsi, simplement parce que les illustrations sont clairement absurdes et font du cosplay une science, nous ne devrions pas négliger la capacité des moteurs d’IA à faire passer les BS pour réelles. Fondamentalement, préviennent les auteurs de l’étude, les articles générés par l’IA pourraient provoquer une crise d’intégrité scientifique. Il semble que cette crise soit bien engagée.

Alexander Pearson, data scientist à l'Université de Chicago et co-auteur de cette étude, notait à l'époque que « la technologie de texte génératif a un grand potentiel pour démocratiser la science, par exemple en facilitant le partage entre scientifiques non anglophones ». leur travail avec la communauté au sens large », mais « il est impératif que nous réfléchissions attentivement aux meilleures pratiques d'utilisation ».

La popularité croissante de l’IA a causé images scientifiquement inexactes de se frayer un chemin dans les publications scientifiques et les articles de presse. Les images de l’IA sont faciles à réaliser et souvent visuellement convaincantes, mais l’IA est tout aussi complexe et, sans surprise, il est difficile de transmettre toutes les nuances de l’exactitude scientifique dans une invite pour un diagramme ou une illustration.

Le récent journal est bien loin des faux journaux des années passées, un panthéon qui comprend des succès tels que «Quel est le problème avec les oiseaux ? » et le Star Trek-œuvre thématique « Changement morphologique génétique et développemental rapide suite à une célérité extrême.»

Parfois, un article soumis à un examen par les pairs est tout simplement amusant. D'autres fois, c'est le signe que « Papeteries» produisent de soi-disant recherches qui n’ont aucun mérite scientifique. En 2021, Springer Nature a été contraint de retirer 44 articles dans l'Arabian Journal of Geosciences pour être totalement absurde.

Dans ce cas, la recherche a peut-être été correcte, mais l’ensemble de l’étude est remis en question par l’inclusion d’images générées par Midjourney. Le lecteur moyen peut avoir du mal à considérer les voies de signalisation lorsqu'il est encore occupé à compter exactement le nombre de balles que le rat est censé avoir.

Plus: ChatGPT écrit assez bien pour tromper les critiques scientifiques

GIPHY App Key not set. Please check settings